����������ҵ��ѧ������Ϣ����ѧԺΤ�����Ŷ��ڡ���ͨ�ż������������ġ����������������ں�ѧϰ�����ڿɼ���λ�ø�֪����������Դ�ͳElman�����������ڿɼ��ⶨλ��������ֲ����š������������⣬�����Ե������һ���ں϶�㼶�����������Ż��㷨�Ļ�ϸ�֪ģ�͡����о�ͨ��������������Ⲣ��������Ż����ԣ���4m×3.5m×3m����ά�ռ���ʵ����ƽ��0.21m�ĸ߾��ȶ�λ��Ϊ���ӻ����µ����ڵ����ṩ����˼·��

�������ſɼ���ͨ�ż����ķ�չ������λ�ø�֪�����ܼҾӡ��ִ�������������������Ȼ������ͳ��������������ͼ���������š��������ﵥһ�Լ��������ʼ�������е�ƿ�������Լ�˶�λ������ϵͳ³���ԡ�Ϊ�ˣ��о��Ŷӹ����˴����߽�����߶�λ��ȫ���̽��������

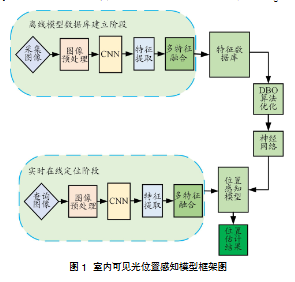

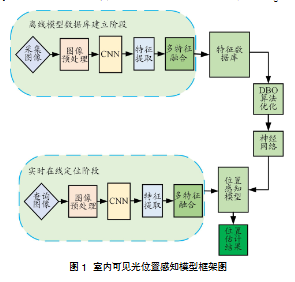

�����ں��ļ������棬�Ŷ���������BM3D�㷨�Բɼ��Ŀɼ���ͼ�����ȥ��Ԥ������������ResNet50��Ⱦ���������ȡͼ��Ķ�㼶��������ͬ�ڵ�һ�㼶��������ȡ���÷��������Եؽ��Ͳ�������߲��������������ںϣ������ú����ɷַ���(KPCA)���з����Խ�ά����������Ϣ�ḻ��“λ�ø�֪������”��Ϊ�˽��Elman������������������������⣬�о������˷���ѧ�㷨——�����Ż���(DBO)�����㷨ģ������Ĺ���ֳ����ʳ����Ϊ����̬�Ż�����������˽ṹ��Ȩ����ֵ������������ģ�͵�ȫ��Ѱ��������

����ʵ������ʾ����ģ����ʵ���ջ����IJ����У����㷨�Ķ�λ����Զ����ͳģ�͡�����ڱ���Elman�㷨����λ����������22.3%;�����BP�����磬�����������ȴ�30%����Ϊֵ��һ����ǣ���ģ���ڲ���������С��0.4m��λ�������Ÿ��ʸߴ�91.3%������0����0.5�IJ�ͬ�߶�ƽ���Ͼ����������õ��ȶ��ԡ�

��������ɹ�������֤�˶������ں������������㷨�ڿɼ��ⶨλ����ľ�DZ����ҲΪ������ڸ��ӳ����µĸ߾���λ�ø�֪�ṩ�˿ɸ��ơ����ƹ�ļ�����ʽ��