����������Ϣ�Ƽ���ѧ�����ѧԺ�����Ŷ��ڡ����ݷ�����֪ʶ�������������ġ���ģ��������ǿ����ν����ںϵĶ�ģ̬��з�������������Զ�ģ̬��з����в�ͬģ̬��б��ﲻһ�¡�Ӱ��Эͬ����Ч�������⣬�����ȫ�µĶ�ģ̬��з����������÷���������ģ̬������ģ����ȡģ̬�ڸ��������Ϣ��ͨ����λ�����ע���������ھ�ģ̬�乲����ģ̬�ڸ�������������ģ̬ע������Ȩ�ںϼ��ģ̬�ںϵ���ʧ��������Ч�����������岻һ�����⣬�ڹ������ݼ�������Ч�����ڶԱ�ģ�͡�

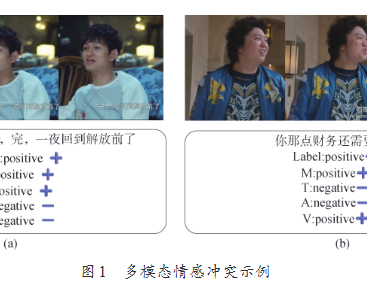

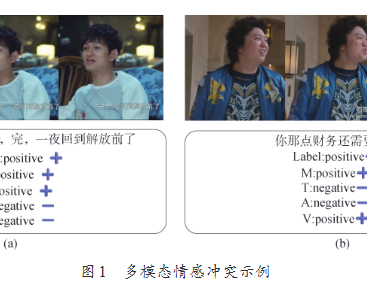

���������罻ý�巢չ����з������ģ̬ת�䣬����ͬģ̬���������岻һ�����⣬������������У���Ϊ��ģ̬��з����Ĺؼ�ʹ�㡣������ط�������������ı�ģ̬����δƽ��ģ̬�乲����ģ̬�ڸ��������Ϣ�Ĺ��ף�������Ч��������⡣

����Ϊ�ˣ������Ŷ��������ΪFEMF�Ķ�ģ̬��з���������������������IJ㼶����������ʾ�㣬�Ŷ������ģ̬������ģ��Gemini�����BERT��OpenFace��Librosa�ȹ��ߣ��ֱ���ȡ�ı����Ӿ�����Ƶģ̬�Ļ�����������ʽ��ϸ���ȸ�������������ḻ�˸�ģ̬�����������ʾ;�����һ������ǿ�㣬��Ʋ�λ�����ע�������ƣ����ı����Ӿ�����Ƶģ̬�������ǿ���������������ͬʱͨ��ģ̬��ע�������Ƽ�Ȩ�ں�ģ̬��������Ϣ��ƽ�ⲻͬ�����Ĺ��ס�

�����Ŷӻ�����������ں�Ƥ��ѷ���ϵ������ʧ��������϶�ģ̬�뵥ģ̬��ʧ��������ģ̬���ģ̬��еĹ�������һ������ģ̬����г�ͻ��ʵ����CH-SIMS��CMU-MOSI�������ݼ�չ���������ʾFEMFģ���ڶ�����ȷ�ʡ�F1ֵ�Ⱥ���ָ���Ͼ�����������ʾ��ע�������ơ���������ͻ�����͵ĶԱ�ģ�ͣ���CH-SIMS��в�һ�������ϣ�������ȷ�ʺ�F1ֵ���Ƿֱ�����1.80��1.72���ٷֵ㡣����ʵ��Ҳ��֤��ģ������ģ�����Ч�ԡ�

�������о���Ч�����˶�ģ̬��з������������һ���Եı��Ϊ���ģ̬����г�ͻ�����ṩ����˼·��Ŀǰģ����δ������Ƶ��������Ի���Ϣ��Ӱ�죬�ŶӺ������۽���ģ̬������ģ��������һ���Ż�ģ�ͶԶ�ģ̬�����Ϣ�ĸ�֪������