【目的】针对多模态情感分析中存在不同模态之间情感表达不一致的现象,影响多模态协同决策效果的问题,提出一种大模型特征增强与多层次交叉融合的多模态情感分析方法。【方法】为缓解各模态之间的冲突情感信息,提高共性情感特征的表达,借助多模态大语言模型提取模态内部辅助性情感信息。利用层次化交叉注意力机制学习模态间的共性情感特征并挖掘模态内的辅助性情感特征,提高共性情感语义的表达。在融合阶段,提出一种模态注意力的加权融合方法,平衡共性情感特征与辅助性情感特征的贡献,并引入融合多模态与单模态的损失函数解决情感语义不一致问题。【结果】本文提出的模型在公开数据集CH-SIMS和CMU-MOSI 上的效果均优于对比模型。在CH-SIMS 上,二分类准确率和F1 值分别提升1.77 和0.63 个百分点;在CMU-MOSI上,二分类准确率和F1值分别提升0.43和0.41个百分点;在CH-SIMS情感不一致数据上,二分类准确率和F1 值分别提升1.80 和1.72 个百分点,可以有效解决不同模态间的情感语义不一致问题。【局限】未考虑到视频中人物的个性化信息带来的影响。【结论】本文利用层次化交叉注意力机制有效融合各模态特征,可以提高共性语义的表达,有效解决不同模态间的情感语义不一致问题。

关键词:多模态情感分析 情感不一致 大模型 特征增强

论文《大模型特征增强与多层次交叉融合的多模态情感分析方法》发表在《数据分析与知识发现》,版权归《数据分析与知识发现》所有。本文来自网络平台,仅供参考。

1 引 言

随着社交媒体的广泛普及,人们可以通过文本、视频、语音等多模态信息表达情感,情感分析从单一模态向多模态转变。不同模态会有一些共享的信息和自身特有的信息。例如,给定一段视频,其文本模态是对此视频中说话者内容的陈述,包含丰富的语义信息,视频模态展示了说话者的表情、动作等,音频模态捕捉声音的音调、语速等。多模态情感分析的主要任务是从多种模态信息中提取共有、独有特征,通过适当的融合方法将这些特征充分融合,获取更准确和全面的情感分析结果。

多模态情感分析旨在从文本、音频以及图像等多模态数据中准确识别人们对某个主题或者商品的情感极性。传统的情感分析主要从文本中识别用户的情感,随着多模态数据的不断增加,仅从单模态角度分析用户的情感不再准确。与单模态情感分析相比,多模态情感分析可以通过对不同模态进行探索和挖掘得到更准确的情感分析效果。

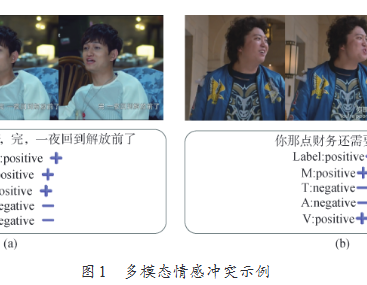

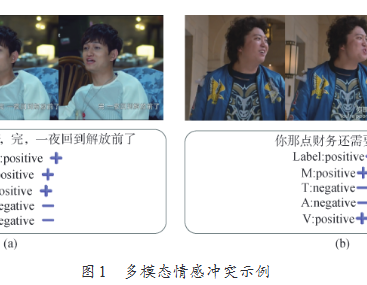

多模态情感分析中不同模态之间存在情感语义不一致问题,可能导致情感误判或情感混淆,影响了多模态情感分析的效果。多模态情感冲突示例如图1所示,其中,M 代表三种模态结合的真实标签,T、A、V 分别代表文本、音频以及视觉模态的真实标签。

(a)就是因为你这个棋谱,完,一夜回到解放前了 Label:positive + M:positive+ T:positive + A:negative V:negative

(b)你那点财务还需要助理 Labelpositive+ M:positive+ T:negative- A:negative- V:positive+

Fig.1 Examples of Multimodal Sentiment Conflict 图1 多模态情感冲突示例

在图1(a)中,其文本模态与多模态的真实标签为正向,视觉及音频模态的真实标签却为负向。在图1(b)中,其文本模态与音频模态的真实标签为负向,视觉模态与多模态的真实标签却为正向。两张图都存在模态间情感冲突的现象。其中,图1(b)中“你那点财务还需要助理”这句话不仅传达了基本的语义信息,还隐含了讽刺、轻蔑、打趣等多种隐式情感表示。在对应视频中,人物脸部的微表情和脸部动作也反映出人物内心的真实情感变化。因此,综合模态间以及模态内两种角度进行建模对解决模态间情感语义不一致问题至关重要。

针对上述问题,罗渊贻等明确了在多模态情感分析任务中考虑情感语义不一致问题的必要性与合理性,引入中心距差异设计损失以学习各模态之间的共性。然而,该方法未有效平衡模态间共性情感信息及模态内辅助性情感知识的贡献。Zhang 等针对模态间情感冲突信息进行模型设计,该方法利用文本引导视频与音频两种模态达到缓解情感冲突的目的。然而,该研究在缓解情感冲突问题时过度依赖文本模态,当文本模态与整体所表达的情感产生冲突时,可能会导致情感混淆。因此,如何有效提取和融合模态内的情感信息以及提高模态间共性情感信息的表达能力,对于解决多种模态间情感语义不一致问题至关重要。

为增强情感语义一致性表达,本文提出一种大模型特征增强与多层次交叉融合的多模态情感分析方法(A Multimodal Sentiment Analysis Method Based on Feature Enhancement of Large Models and MultiLevel Cross-Fusion,FEMF)。在单模态特征提取方面,现有研究通常采用卷积神经网络、循环神经网络以及预训练模型等获取各模态的特征。本文引入多模态大语言模型(Multimodal Large Language Models, MLLM)Gemini,借助其强大的上下文情感理解能力,挖掘文本与视频模态的情感知识,获取更完善的情感特征表示。设计融合共性特性表示的情感一致性增强层,分别从模态间和模态内两个角度进行建模。首先,利用层次化交叉注意力机制,通过文本、视频、音频两两模态相互引导的方式,提高共性情感语义表达。其次,利用模态自注意力机制以基于模态注意力的加权融合方式融合两种模块信息,有效平衡两种模块的贡献。最后,利用相关系数调节多模态和单模态的损失权重,提升模型对整体情感信息的理解和分析能力。

本文主要贡献如下:

(1)引入多模态大语言模型在特征表示阶段进行情感知识提取,在多模态融合阶段辅助缓解情感冲突问题。

(2)针对模态间与模态内两个角度设计融合共性特性表示的情感一致性增强层,有效缓解各模态间的情感冲突问题。

(3)引入相关系数进行调节,平衡多模态与单模态输出的贡献,提升模型的预测性能和准确性。

2 相关研究

2.1 多模态情感分析

随着用户情感表达形式的多样化,多模态情感分析逐渐成为一个重要的研究方向,其中,完善特征表示以及有效融合跨模态数据是多模态情感分析的重点与难点。已有的多模态情感分析方法主要针对多模态特征表示以及多模态融合方法进行深入研究。例如,在多模态特征表示阶段,Xue 等提取视觉模态的全局特征和局部特征加强特征表示。Chen 等联合图像与文本提取两种模态间的共性情感标签丰富底层特征用于融合过程。在多模态融合阶段,Jin等设计了一个推理模型,将多模态表示连接作为推理模型的输入,提供了一种新颖的模态融合思路。Tsai 等利用注意力机制对齐三种模态信息,将对齐后的模态信息拼接融合。Yu 等运用多任务学习方法,将各单模态标签拼接融合,通过单标签生成模块辅助多模态情感分析任务。Mai 等利用图结构融合方法融合来自不同层次的单峰和多峰特征。Chauhan 等将情绪分析和情感分析作为子任务帮助检测多模态讽刺,提出一种具有两种新颖注意机制的多任务框架,融合多模态特征。张昱等同时建模文本与音频两种模态,利用注意力机制融合多模态特征。

可见多模态情感分析领域取得了显著进展,但在特征表示阶段仍存在特征表示不完全的问题,丰富的特征表示有助于加强模型对于整体情感的理解。此外,特征融合阶段还面临着不同模态情感信息语义不一致的问题。在特征融合过程中,如果直接将不同模态的信息进行融合,而没有充分考虑它们之间的差异,模型可能会受到来自不同模态间的信息冗余、噪声干扰等因素的影响,难以准确识别情感。

2.2 情感语义不一致

在多模态情感分析中,如何解决情感语义不一致问题是一项具有挑战性的工作。目前关注解决该问题的研究相对较少,其中,Zhang等提出一种自适应的融合模块(Adaptive Hyper-modality Learning, AHL),以文本为主导,通过利用Transformer 框架进行堆叠,设计了一种交互式网络架构,解决模态之间的情感信息冲突问题。但该模型存在一定局限性: 首先,AHL 模型主要聚焦于模态间的情感冲突,忽视了每个模态内部含有的辅助性情感表示。文本中的一些隐式情感可能隐藏在复杂的词汇和句式结构中,而在图像和视频中则可能体现在人物脸部的动作细节和情感状态中。忽略上述信息可能导致模型在情感表达上出现偏差。其次,文本模态的情感表达可能与整体情感表达产生冲突。因此,过度依赖文本信息可能导致模型对情感的理解出现偏差,进而引发情感混淆问题。罗渊贻等深入探讨情感语义不一致问题在多模态情感分析任务中的必要性与合理性,并基于两种模态的注意力加权连接与中心距差异设计损失学习所有模态之间的共性。但该方法忽略了模态内的辅助性情感知识对缓解情感冲突的影响程度。在多模态情感分析中,每种模态不仅包含与其他模态相关的共性情感特征,还蕴含着模态内独特的辅助性情感知识。这些信息对于准确理解情感状态、缓解模态间的情感冲突至关重要。此外,在注意力机制的融合阶段,该方法将两种模态交互的注意力结果进行叠加,虽然简化了计算过程,但却忽视了各模态之间交互贡献程度的差异。因此,本文提出一种大模型特征增强与多层次交叉融合的多模态情感分析方法,针对模态间、模态内两个角度进行模型设计,综合缓解各模态情感语义不一致问题,提高共性情感特征的表达能力。

2.3 多模态大语言模型

近年来,多模态大语言模型在不同的生成任务中展现出强大的性能,由于其具备丰富的先验知识,已广泛应用于众多领域。从学术研究视角来看,视觉问答、图像字幕生成等任务中均可见多模态大语言模型的应用。其中,MiniGPT-4和LLaVA在预训练阶段冻结视觉模型和语言模型的参数,并使用额外的投影层对齐这两种模态的特征。mPLUGOwl通过低秩自适应(Low-Ranking Adaption, LoRA)使模型能够有效地对齐视觉特征及语言特征,提高模型对多模态数据的处理能力。在产品应用角度,也涌现出一些多模态大模型。例如 Gemini提供了一个多模态大模型体系,在图像和文本理解方面表现出卓越的能力,适用于从复杂推理任务到移动设备的各种应用。GPT4o可以同时实现对文本、视觉以及音频领域的信息处理,适用于更加复杂的情况,在响应速度和推理任务等方面的效果均显著提升。

上述多模态大模型在生成领域取得了优秀表现,但在多模态情感分析领域的应用却相对较少。原因在于,大语言模型本身的结构和训练目标使其更擅长文本生成和理解任务,而多模态情感分析涉及文本、音频、视频等多种模态的信息,要求模型能够跨模态地理解和融合这些信息,存在一定难度。因此,本文利用多模态大语言模型提取各模态内丰富的情感知识,在融合阶段将情感知识进行有效融合,增强模型的整体情感理解能力,辅助缓解模态间情感冲突。

3 研究方法

3.1 模型概述

FEMF的整体架构与处理流程如图2所示。

图2 FEMF的整体架构与处理流程 Fig.2 Framework Diagram of Multimodal Sentiment Analysis Method Based on Large-Model Feature Enhancement and Multi-Level Cross-Fusion

模型主要包括基于大模型特征增强的多模态特征表示层以及融合共性特性表示的情感一致性增强层。

在基于大模型增强的多模态特征表示层中,基于各预训练模型及工具提取全局特征表示,利用多模态大语言模型提取模态内部的辅助性情感知识。在融合共性特性表示的情感一致性增强层中,为充分解决模态间的情感语义不一致问题,利用跨模态Transformer设计一种基于模态间与模态内的交互式网络架构,有效融合模态间的共性信息以及模态内的特性信息。最后,进行最终模型的预测并通过融合多模态以及单模态的损失函数进行优化学习。

3.2 基于大模型增强的多模态特征表示层

(1)文本模态特征提取

对于文本内容,首先进行文本预处理,去除句子中的停用词等。然后,使用BERT对处理后的文本进行编码,得到句子的向量表示 (Te),如公式(1)所示。

[T e=BERTleft(w_{i}, heta_{i}^{bert }

ight) in mathbb{R}^{d_{i}} (1)]

其中,(w_{1})代表句子中的词,( heta_{t}^{bent })代表模型参数,(d_{t})代表维度。

为更全面地把握文本的情感内涵,准确理解文本中蕴含的情感倾向,对视频片段进行关键帧抽取,再利用多模态大语言模型Gemini 出色的情感理解能力结合目标文本与视频中关键帧的整体人物情感状态进行隐式情感提取,利用BERT 对提取结果进行编码,得到隐式情感标签的向量表示 (Ttag),对于情感标签为空的情况,以同维度的零向量表示Ttag。

将两种向量编码进行拼接得到文本特征 (F_{t}),如公式(2)所示。

[F_{t}=concatleft(Te,Ttag

ight) (2)]

(2)视觉模态特征提取

针对整体视频特征,使用OpenFace获得视频中的人脸动作和表情的向量表示 (V e)。

针对视频中的关键帧特征,使用多模态大语言模型Gemini 提取视频关键帧中的细粒度情绪标签,例如“生气” “担心” “消极”等。利用BERT 对其编码得到向量表示 (Vtag)。由于视频信息与上下文有较强的相关性,因此,使用Transformer 的编码器捕获时序特征,获得最终的视觉特征 (F_{v}),如公式(3)所示。

[F_{v}=Encoder(concat(Ve, Vtag))]

(3)音频模态特征提取

对于语音特征,使用音频处理模型Librosa获取初始特征向量 (E_{a})。考虑到音频信息与上下文有较强的关联性,使用Transformer 编码器捕获时间特征,得到最终音频特征的向量编码 (F_{a}),如公式(4)所示。

[F_{a}=Encoderleft(E_{a}

ight) (4)]

3.3 融合共性特性表示的情感一致性增强层

(1)融合共性表示的情感一致性增强

利用文本模态中的有效情感信息增强其他模态的情感特征,使视频与音频模态能够更准确地反映情感状态。考虑到文本模态存在与整体情感表达相矛盾的问题,采用文本与视觉、音频模态相互引导的方式,即在文本模态引导其他模态之后,利用经过调和的其他模态进一步修正和缓解文本模态中的冲突情感信息,以充分解决模态间情感语义不一致的问题,提高共性情感的一致性表达。

基于上述思路,对网络架构进行设计,利用文本模态为主导的特性,通过模态间反复强化达到深层次增强情感一致性的目的。具体流程如公式(5)-公式(7)所示。

[Y_{g}=Softmaxleft(frac{Q_{F_{t}} K_{F_{g}}^{ op}}{sqrt{d_{k}}}

ight) V_{F_{g}}=]

[�egin{gathered} Y_{g o t}=Softmaxleft(frac{Q_{F_{t}} K_{Y_{g}}^{T}}{sqrt{d_{k}}}

ight) V_{Y_{g}}= \ Softmaxleft(frac{H_{F_{t}} W_{Q_{t}} W_{K_{g}}^{T} H_{Y_{g}}^{T}}{sqrt{d_{k}}}

ight) H_{Y_{g}} W_{V_{g}} end{gathered}]

[Y_{t}=Encoderleft(F_{t}, Y_{g o t}

ight) quad(7)]

其中,(g in{a, v}),(Y_{g})为用于模型决策的语音及视频向量,(Y_{g o t})代表视觉及语音两种模态增强文本表示的过程,(Y_{t})为用于模型决策的文本向量。

(2)融合特性表示的情感一致性增强

为进一步探究各单模态中包含的特性表示对解决模态间情感语义不一致问题的贡献,通过自注意力机制对各单模态进行训练。考虑到将融合共性表示的增强过程以及融合特性表示的增强过程进行叠加会影响解决情感语义不一致问题的效率,利用模态内注意力机制结合对应注意力分数进行加权融合,得到最终的融合向量表示。各模态的注意力分数代表其拟合程度的重要性,将其进行均值化分别与对应向量做乘积,达到有效分配各模态权重促进两个网络有效融合的目的,具体如公式(8)-公式(10)所示。

[O_{u}=Softmaxleft(frac{Q_{F_{u}} K_{F_{u}}^{T}}{sqrt{d_{k}}}

ight) V_{F_{u}}]

[O_{attscore }^{u}=Softmaxleft(frac{H_{F_{u}} W_{Q_{u}} W_{K_{u}}^{T} H_{F_{u}}^{T}}{sqrt{d_{k}}}

ight)]

[Y_{u}^{*}=Y_{u}+O_{u} cdot frac{frac{1}{n} sum_{j=1}^{n} O_{attscore }^{u}}{frac{1}{n} sum_{j=1}^{n}left(O_{attscore }^{t}+O_{attscore }^{a}+O_{attscore }^{v}

ight)}(10)]

其中,(u in{t, a, v}),(O_{u})为用于任务决策的各单模态表示,(O_{attscore }^{u})为对应模态的注意力分数,(j)代表对应样本,(Y_{u}^{*})代表最终用于模型预测的各单模态向量表示。

3.4 损失函数

在多模态情感分析任务中,为解决情感语义不一致的问题,提出一种损失函数设计思路,综合考虑多模态损失以及单模态损失结合相关系数进行损失函数设计。具体地,通过在损失函数中融合皮尔逊相关系数(Pearson Correlation Coefficient,PCCs),引导模型在最小化预测误差的同时,增强单模态预测情绪得分与实际预测情绪得分之间的相关性。这种设计有助于拉近单模态与多模态情感间的关联关系,更好地缓解模态间情感冲突。本文使用平均绝对误差损失(L1loss),结合PCCs,对整体损失函数进行设计,考虑到单模态间互补融合的关系,将PCCs 的范围取值通过线性变换映射至0 到1 区间。样本间的皮尔逊相关系数如公式(11)所示。

[r_{x, y}=frac{1}{2}left(1+frac{sum_{i=1}^{n}left(X_{i}-overline{X}

ight)left(Y_{i}-overline{Y}

ight)}{sqrt{sum_{i=1}^{n}left(X_{i}-overline{X}

ight)^{2}} sqrt{sum_{i=1}^{n}left(Y_{i}-overline{Y}

ight)^{2}}}

ight)(11)]

其中,(i)为样本,(X_{i})为单模态预测样本,(Y_{i})为多模态预测样本,(�ar{X})和(�ar{Y})代表样本平均值,(r_{x, y})代表单模态预测样本与多模态预测样本的相关系数。

使用带有ReLU 激活函数的多层感知器 (Multilayer Perceptron, MLP)作为分类器获得最终的预测结果,通过L1loss计算多模态预测损失,如公式(12)和公式(13)所示。

[y_{m}^{p}=MLPleft(left[Y_{t}^{*}, Y_{a}^{*}, Y_{v}^{*}

ight]

ight)]

[L_{m}=frac{1}{n} sum_{p=1}^{n}left|y_{m}^{Lambda}-y_{m}^{p}

ight|]

其中,m 代表多模态,p 代表对应样本,(y_{m}^{Lambda})代表真实标签,(y_{m}^{p})代表预测结果。

对于每个样本 p,分别输入权重共享的MLP 分类器中,利用L1loss 进行损失计算,如公式(14)-公式(15)所示。

[y_{u}^{p}=MLPleft(Y_{u}^{*}

ight) quad(14)]

[L_{u}=frac{1}{n} sum_{p=1}^{n}left|y_{u}^{Lambda}-y_{u}^{p}

ight|]

其中,(n)代表样本总量,(y_{u}^{Lambda})代表真实标签,(y_{u}^{p})代表预测结果。

最终的损失函数如公式(16)所示。

[Loss =L_{m}+r_{x', y'}^{t} cdot L_{t}+r_{x', y'}^{a} cdot L_{a}+r_{x', y'}^{v} cdot L_{v} quad(16)]

其中,(x')与(y')代表单模态预测与多模态预测的对应样本。

4 实验结果和分析

4.1 数据集

为验证本文所提方法的有效性,在公开的中文多模态情感分析数据集CH-SIMS和英文数据集 CMU-MOSI上进行实验。

(1)CH-SIMS 数据集:该数据集是一个独特的细粒度注释的中文多模态情感分类数据集,包括不同数据源下的2 281 个视频片段,说话人数共474 人,模态类别包括视觉、语音和文本三种。视频含自发表情、多样头部姿势及遮挡,注释者对样本按照-1 (强消极)到1(强积极)区间进行标注。

(2)CMU-MOSI数据集:该数据集基于YouTube 的视频构建,注释者按-3(强消极)到3(强积极)区间标注样本评分。

4.2 对比模型

为体现本文提出模型的有效性,将FEMF 与现有的4种类别共9个模型在公开数据集上进行对比。

(1)基于张量表示的模型

TFN:基于笛卡尔积计算各模态的张量,利用模态嵌入的方法对各模态张量进行模态间的交互。

(2)基于注意力机制的模型

MFN:在模型构建过程中,引入记忆融合机制捕捉序列之间的依赖关系并通过调整独立因子重构缺失模态的信息。

MULT:在模态的序列表示基础上添加了位置编码和卷积层。利用Transformer 结构,在两两模态间分别使用交互注意力融合。

MISA:通过各模态不变信息与基于注意力机制的跨模态融合信息实现模态内和模态间信息的有效融合。

MAWF:将各模态通过自适应调节网络以及注意力网络联合进行训练,两者协同执行多模态情感分析任务。

(3)基于多视角建模的模型

MMIM:利用最大化互信息对不同层级之间进行特征融合,将多模态融合结果和单模态分层输入,实现与主任务的联合训练。

Self-MM:利用自动生成标签任务训练得到各单模态的标签并与主模态标签进行联合训练,协同进行情感分析任务。

(4)基于情感语义冲突的模型

ALMT:针对潜在情感冲突矛盾问题建模,通过跨模态注意力机制利用文本模态作为主导的方法,加强情感理解程度。

MSSL: 基于多模态中心距差异进行建模,引入时空注意力以及模态注意力,缓解情感语义不一致的问题。

4.3 模型评估与参数设置

使用6 种评价指标评估模型性能,分别为二分类准确率(ACC-2)、F1 分值(F1-Score)、平均绝对误差(Mean Absolute Error,MAE)、三分类准确率 (ACC-3)、七分类准确率(ACC-7)以及相关系数 (Corr)。

实验框架为PyTorch,模型的参数设置如表1 所示。

表1 实验参数设置 Table 1 Experimental Parameters Setting

| 参数 | 参数值 | 参数 | 参数值 |

| 跨模态注意力维度 | 50 | Learning_rate | 0.001 |

| 跨模态注意力头数 | 10 | Dropout | 0.3 |

| 优化器 | Adam | Early_stop | 8 |

| 迭代次数 | 20 | Batch_size | 16 |

4.4 对比实验分析

为充分验证所提方法的有效性,将FEMF 与基于张量表示的模型、基于注意力机制的模型、基于多视角建模的模型、基于情感语义冲突的模型在CH-SIMS 与CMU-MOSI 数据集上进行对比。其中,为充分利用CH-SIMS 数据集中的单模态标签并突出本文方法在处理多任务学习时的有效性,增加单模态训练任务,整体对比实验结果如表2 和表3 所示。其中,a 代表来源于多模态情感分析框架中Yu 等的结果,b代表来源于原论文中公布的结果。

表2 CH-SIMS数据集上的实验结果 Table 2 Experimental Results on the CH-SIMS Dataset

| 模型类型 | 多任务 | 模型 | Acc-2 ( % )(↑) | Acc-3 ( % )(↑) | F1-Score ( % )(↑) | MAE (↓) | Corr (↑) |

| 基于张量表示 | × | TFN a | 78.38 | 65.12 | 78.62 | 0.432 | 0.591 |

| 基于注意力机制 | × | MFN a | 77.90 | 65.73 | 77.88 | 0.435 | 0.582 |

| | × | MULT a | 78.56 | 64.77 | 79.66 | 0.453 | 0.564 |

| | × | MISA a | 79.43 | 64.55 | 79.70 | 0.428 | 0.576 |

| | × | MAWF b | 80.96 | - | 81.28 | - | - |

| 基于多视角建模 | × | MMIM a | 79.56 | 64.46 | 79.90 | 0.451 | 0.587 |

| | √ | Self_MM a | 80.04 | 65.47 | 80.44 | 0.425 | 0.595 |

| 基于情感语义冲突 | × | ALMT b | 81.19 | 68.93 | 81.57 | 0.404 | 0.619 |

| | √ | MSSL b | 81.20 | - | 82.50 | - | - |

| | √ | FEMF | 82.97 | 69.31 | 83.13 | 0.393 | 0.663 |

表3 CMU-MOSI数据集上的实验结果 Table 3 Experimental Results on the CMU-MOSI Dataset

| 模型类型 | 模型 | Acc-2 ( % )(↑) | Acc-7 ( % )(↑) | F1-Score ( % )(↑) | MAE (↓) | Corr (↑) |

| 基于张量表示 | TFN a | 79.08 | 34.46 | 79.11 | 0.947 | 0.673 |

| 基于注意力机制 | MFN a | 78.87 | 35.83 | 78.90 | 0.926 | 0.670 |

| | MULT a | 80.98 | 36.91 | 80.95 | 0.879 | 0.702 |

| | MISA a | 83.54 | 41.37 | 83.58 | 0.776 | 0.778 |

| | MAWF b | 86.28 | - | 86.38 | 0.716 | 0.791 |

| 基于多视角建模 | MMIM a | 84.23 | 42.43 | 84.17 | 0.738 | 0.784 |

| | Self_MM a | 85.46 | 46.67 | 85.43 | 0.708 | 0.796 |

| 基于情感语义冲突 | ALMT b | 86.43 | 48.42 | 86.47 | 0.683 | 0.805 |

| | MSSL b | 86.60 | 47.40 | 86.70 | 0.709 | 0.796 |

| | FEMF | 87.03 | 48.98 | 87.11 | 0.678 | 0.818 |

FEMF 模型在CMU-MOSI 和CH-SIMS 公开数据集上的结果均优于对比模型。相较于基于张量表示的模型TFN,FEMF 在各项评价指标中均更优,这表明FEMF 更注重加强各模态的特征表示以及关注跨模态的融合过程。相较于基于注意力机制的模型(MFN、MULT、MISA、MAWF),FEMF 的各项评价指标也更优,这表明FEMF 更加注重情感信息的重要程度,所构建的大模型特征增强模块可以进一步强化整体情感理解,并丰富单一模态下的情感表达。在融合阶段设计的跨模态交互融合方法可以有效处理情感不一致问题。

在CH-SIMS 数据集上,相比于多视角建模的模型(MMIM、Self-MM),FEMF 效果更佳,这表明,FEMF 设计的融合方法通过有效整合单模态信息表示,并在融合中采用多层次交互策略,有效缓解了模态间的情感冲突问题。相较于基于情感语义冲突的模型,FEMF 取得了最优的效果,这是因为其利用大语言模型进行特征增强,从而加强了情感理解。此外,通过综合关注模态间共性以及模态内特性表示设计了层次化的注意力融合方法,增强了整体情感信息的一致性表达。最后,通过结合加强特征表示以及模态融合交互两种角度共同缓解模态情感冲突问题,使多模态情感分析的性能达到最佳。

4.5 有效性分析

为进一步验证FEMF 模型缓解情感冲突问题的有效性,从CH-SIMS 数据集中筛选出各单模态情感标签不一致的数据作为分析对象(CH-SIMS 数据集提供了各单模态情感标签,而CMU-MOSI 并未提供),对比FEMF模型与其他对比模型的效果。

统计结果显示,CH-SIMS 中共有2 281 条数据,其中存在720 条不同模态情感语义表达不一致的数据,如表4所示。FEMF模型与对比模型在情感语义不一致数据上的结果如表5所示。

表4 CH-SIMS数据集的数据划分 Table 4 Data Partitioning of the CH-SIMS Dataset

| 数据分布情况 | 总数 | 训练集 | 验证集 | 测试集 |

| 数据整体分布 | 2281 | 1368 | 456 | 457 |

| 情感语义不一致数据分布 | 720 | 431 | 137 | 152 |

表5 CH-SIMS测试集中情感语义不一致数据上的模型对比 Table 5 Comparison of Models on Sentiment Semantic Inconsistent Data in the CH-SIMS Test Dataset

| 模型 | Acc-2%(↑) | Acc-3%(↑) | F1-Score%(↑) | MAE(↓) | Corr(↑) |

| FEMF | 73.73 | 61.91 | 72.15 | 0.429 | 0.494 |

| MULT | 71.93 | 56.93 | 70.06 | 0.441 | 0.435 |

| Self-MM | 69.38 | 57.74 | 68.76 | 0.439 | 0.427 |

| ALMT | 70.79 | 59.37 | 73.87 | 0.437 | 0.468 |

相比于其他模型,FEMF 可以更好地缓解情感语义不一致问题,在情感冲突数据集上的效果优于对比模型。这是由于FEMF 模型引入了额外的辅助性情感知识用于增强情感语义的理解。此外,FEMF 模型在融合过程中重点考虑模态的共性以及特性表示,能有效解决情感语义不一致的问题,在复杂情感环境中表现更佳。

为更直观地展示FEMF 模型在解决情感冲突问题时的有效性,将FEMF 与对比模型在三条典型的存在情感冲突的示例上进行实验与分析,如图3 所示。

(a)非常理解您想请朋友们把酒言欢的心情。 Text label:+ Mult:pos Visual label:- Audio label:- Self-mm:neu ALMT:neu FEMF:neg

(b)咱们集团什么职位比较轻松啊 Text label:+ Mult:pos Visual label:+ Audio label:- Self-mm:neu ALMT:neu FEMF:neg

(c)这样吧,你自己说说,我希望你们都提起精神来,给我好好考 Text label:+ Mult:neg Visual label:- Audio label:- Self-mm:neu ALMT:pos FEMF:pos

图3 情感不一致示例与不同模型的结果展示 Fig.3 Presentation of Sentiment Inconsistent Examples and the Results of Different Models

在图3(a)与图3(b)中,FEMF 模型正确预测了积极的情感极性,但MULT、Self-MM 与ALMT 模型都预测错误,这是因为MULT 和Self-MM 模型并未深度关注多模态情感语义不一致的现象,而ALMT 模型更加关注利用文本模态引导并缓解其他两种模态的冲突,导致模型未能充分解决模态间的情感不一致问题。针对各模态情感表达不一致的问题,FEMF 模型可以利用各模态相互引导的方式设计更佳的融合策略,更好地提高各模态的共性情感表达。在图3(c)中,FEMF 与ALMT 模型正确地预测了积极的情感极性,而MULT 与Self-MM 都预测错误,这是由于MULT 和Self-MM 模型忽略了模态间的情感冲突信息,导致模型未能准确识别正确的情感。

综上,FEMF 模型在处理各模态情感信息表达不一致问题时效果更好。

4.6 消融实验分析

通过4组消融实验验证FEMF不同模块的作用,如表6和表7所示。

表6 在CH-SIMS数据集上的消融实验结果 Table 6 Ablation Study Results on the CH-SIMS Dataset

| 模型 | Acc-2 ( % )(↑) | Acc-3 ( % )(↑) | F1-Score ( % )(↑) | MAE (↓) | Corr (↑) |

| w/o Text emotion | 81.57 | 67.32 | 81.49 | 0.425 | 0.623 |

| w/o Visual emotion | 82.13 | 68.17 | 82.18 | 0.405 | 0.646 |

| without A1 | 82.48 | 68.85 | 82.32 | 0.413 | 0.649 |

| without A2 | 81.36 | 68.38 | 81.53 | 0.430 | 0.637 |

| FEMF | 82.97 | 69.31 | 83.13 | 0.393 | 0.663 |

表7 在CMU-MOSI数据集上的消融实验结果 Table 7 Ablation Study Results on the CMU-MOSI Dataset

| 模型 | Acc-2 (%)(↑) | Acc-7 (%)(↑) | F1-Score (%)(↑) | MAE(↓) | Corr (↑) |

| w/o Text emotion | 85.36 | 45.88 | 85.26 | 0.713 | 0.782 |

| w/o Visual emotion | 86.18 | 46.73 | 85.73 | 0.703 | 0.792 |

| without A1 | 86.67 | 48.45 | 86.32 | 0.684 | 0.808 |

| without A2 | 85.23 | 46.32 | 85.26 | 0.722 | 0.789 |

| FEMF | 87.03 | 48.98 | 87.11 | 0.678 | 0.818 |

(1)针对文本模态利用多模态大语言模型抽取的隐式情感表示进行消融分析。消融实验中仅保留 BERT 提取的原语义信息,结果表明,丰富原文本语义的隐式情感更有利于辅助缓解情感冲突。

(2)针对视频模态利用多模态大语言模型抽取的细粒度情感表示进行消融分析。消融实验中只保留OpenFace 提取的视觉特征,结果表明,视觉情绪更有利于任务的决策。

(3)对提出的模态内辅助性情感表示补充模块进行消融分析,消融实验中只保留模态间情感冲突缓解模块,结果表明,模态内辅助性情感表示补充模块有利于模态间情感冲突缓解模块的设计,两者协同工作可实现更完善的共性情感表达。

(4)对提出的模态间情感冲突缓解模块进行消融分析,消融实验中只保留模态内情感补充模块,结果证明了模态间情感冲突缓解模块的重要作用,对模态间的冲突情感信息进行缓解可以极大地提升多模态情感分析任务的分析效果。

5 结 语

针对多模态信息在融合过程中出现的模态间情感语义不一致问题,本文提出一种大模型特征增强与多层次交叉融合的多模态情感分析方法。首先采用多模态大语言模型提供的丰富先验情感知识,补充文本与视觉模态的语义信息,辅助缓解情感冲突。在此基础上,利用层次化交叉注意力机制提出融合共性特性表示的情感一致性增强层,有效融合模态内的特性表示以及模态间共性表示,解决情感语义不一致的问题。最后,利用皮尔逊相关系数进行损失函数设计,综合提升多模态情感分析的性能。将 FEMF 模型与现有的多模态情感分析模型在CMU-MOSI 和CH-SIMS 数据集上进行对比,结果显示 FEMF 模型在所有评估指标中皆优于对比模型,消融实验进一步验证了FEMF 模型解决多模态情感语义不一致问题的有效性。

虽然FEMF 有效解决了多模态情感语义的不一致问题,但仍存在一定局限性,例如未考虑视频中人物个性化信息的影响。未来研究将聚焦于多模态大语言模型的微调方向,借助大语言模型的先验知识优化模型参数,将其应用于多模态情感分析任务,以提升模型对多模态情感信息的感知效果。

参考文献

[1] 罗渊贻, 吴锐, 刘家锋, 等. 面向情感语义不一致的多模态情感分析方法[J]. 计算机研究与发展, 2025, 62(2): 374-382.(Luo Yuanyi, Wu Rui, Liu Jiafeng, et al. Multimodal Sentiment Analysis Method for Sentimental Semantic Inconsistency[J]. Journal of Computer Research and Development, 2025, 62(2): 374-382.)

[2] Zhang H Y, Wang Y, Yin G H, et al. Learning Language-Guided Adaptive Hyper-Modality Representation for Multimodal Sentiment Analysis[C]//Proceedings of the 2023 Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA, USA: ACL, 2023: 756-767.

[3] Poria S, Cambria E, Gelbukh A. Deep Convolutional Neural Network Textual Features and Multiple Kernel Learning for Utterance-Level Multimodal Sentiment Analysis[C]//Proceedings of the 2015 Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA, USA: ACL, 2015: 2539-2544.

[4] Akhtar M S, Chauhan D, Ghosal D, et al. Multi-Task Learning for Multi-Modal Emotion Recognition and Sentiment Analysis [C]//Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies. Stroudsburg, PA, USA: ACL, 2019: 370-379.

[5] Devlin J, Chang M W, Lee K, et al. BERT: Pre-Training of Deep Bidirectional Transformers for Language Understanding[C]// Proceedings of the 2019 Conference of the North American Chapter of the Association for Computational Linguistics: Human Language Technologies. Stroudsburg, PA, USA: ACL, 2019: 4171-4186.

[6] Anil R, Borgeaud S, Alayrac J B, et al. Gemini: A Family of Highly Capable Multimodal Models[OL]. arXiv Preprint, arXiv: 2312.11805.

[7] Xue X J, Zhang C X, Niu Z D, et al. Multi-Level Attention Map Network for Multimodal Sentiment Analysis[J]. IEEE Transactions on Knowledge and Data Engineering, 2023, 35(5): 5105-5118.

[8] Chen D L, Su W, Wu P, et al. Joint Multimodal Sentiment Analysis Based on Information Relevance[J]. Information Processing & Management, 2023, 60(2): 103193.

[9] Jin Q, Li C X, Chen S Z, et al. Emotion Recognition Using Acoustic and Lexical Features[C]//Proceedings of the 2015 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). 2015: 366-369.

[10] Tsai Y H, Bai S J, Liang P P, et al. Multimodal Transformer for Unaligned Multimodal Language Sequences[C]//Proceedings of the 57th Annual Meeting of the Association for Computational Linguistics. 2019: 6558-6569.

[11] Yu W, Xu H, Yuan Z, et al. Learning Modality-Specific Representations with Self-Supervised Multi-Task Learning for Multimodal Sentiment Analysis[C]//Proceedings of the 2021 AAAI Conference on Artificial Intelligence. AAAI Press, 2021: 10790-10797.

[12] Mai S, Hu H, Xing S. Modality to Modality Translation: An Adversarial Representation Learning and Graph Fusion Network for Multimodal Fusion[C]//Proceedings of the 2020 AAAI Conference on Artificial Intelligence. AAAI Press, 2020: 164-172.

[13] Chauhan D S, Dhanush S R, Ekbal A, et al. Sentiment and Emotion Help Sarcasm? A Multi-Task Learning Framework for Multi-Modal Sarcasm, Sentiment and Emotion Analysis[C]// Proceedings of the 58th Annual Meeting of the Association for Computational Linguistics. Stroudsburg, PA, USA: ACL, 2020: 4351-4360.

[14] 张昱, 张海军, 刘雅情, 等. 基于双向掩码注意力机制的多模态情感分析[J]. 数据分析与知识发现, 2023, 7(4): 46-55.(Zhang Yu, Zhang Haijun, Liu Yaqing, et al. Multimodal Sentiment Analysis Based on Bidirectional Mask Attention Mechanism[J]. Data Analysis and Knowledge Discovery, 2023, 7(4): 46-55.)

[15] Zhu D Y, Chen J, Shen X Q, et al. MiniGPT-4: Enhancing VisionLanguage Understanding with Advanced Large Language Models [OL]. arXiv Preprint, arXiv: 2304.10592.

[16] Liu H T, Li C Y, Wu Q Y, et al. Visual Instruction Tuning[OL]. arXiv Preprint, arXiv: 2304.08485.

[17] Ye Q H, Xu H Y, Xu G H, et al. mPLUG-Owl: Modularization Empowers Large Language Models with Multimodality[OL]. arXiv Preprint, arXiv: 2304.14178.

[18] Hu E J, Shen Y, Wallis P, et al. LoRA: Low-Rank Adaptation of Large Language Models[OL]. arXiv Preprint, arXiv: 2106.09685.

[19] Shen X, Wu Y, Backes M, et al. Voice Jailbreak Attacks Against GPT-4o[OL]. arXiv Preprint, arXiv: 2405.19103.

[20] Baltrusaitis T, Zadeh A, Lim Y C, et al. OpenFace 2.0: Facial Behavior Analysis Toolkit[C]//Proceedings of the 13th IEEE International Conference on Automatic Face & Gesture Recognition. IEEE, 2018: 59-66.

[21] McFee B, Raffel C, Liang D W, et al. Librosa: Audio and Music Signal Analysis in Python[C]//Proceedings of the 14th Python in Science Conference. SciPy, 2015: 18-25.

[22] Yu W M, Xu H, Meng F Y, et al. CH-SIMS: A Chinese Multimodal Sentiment Analysis Dataset with Fine-Grained Annotation of Modality[C]//Proceedings of the 58th Annual Meeting of the Association for Computational Linguistics. Stroudsburg, PA, USA: ACL, 2020: 3718-3727.

[23] Zadeh A, Zellers R, Pincus E, et al. MOSI: Multimodal Corpus of Sentiment Intensity and Subjectivity Analysis in Online Opinion Videos[J]. IEEE Intelligent Systems, 2016, 31(6): 82-88.

[24] Zadeh A, Chen M H, Poria S, et al. Tensor Fusion Network for Multimodal Sentiment Analysis[C]//Proceedings of the 2017 Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA, USA: ACL, 2017: 1103-1114.

[25] Zadeh A, Liang P P, Mazumder N, et al. Memory Fusion Network for Multi-View Sequential Learning[C]//Proceedings of the 2018 AAAI Conference on Artificial Intelligence. 2018: 5634-5641.

[26] Hazarika D, Zimmermann R, Poria S. MISA: Modality-Invariant and -Specific Representations for Multimodal Sentiment Analysis [C]//Proceedings of the 28th ACM International Conference on Multimedia. ACM, 2020: 1122-1131.

[27] 罗渊贻, 吴锐, 刘家锋, 等. 基于自适应权值融合的多模态情感分析方法[J]. 软件学报, 2024, 35(10): 4781-4793.(Luo Yuanyi, Wu Rui, Liu Jiafeng, et al. Multimodal Sentiment Analysis Method Based on Adaptive Weight Fusion[J]. Journal of Software, 2024, 35(10): 4781-4793.)

[28] Han W, Chen H, Poria S. Improving Multimodal Fusion with Hierarchical Mutual Information Maximization for Multimodal Sentiment Analysis[C]//Proceedings of the 2021 Conference on Empirical Methods in Natural Language Processing. Stroudsburg, PA, USA: ACL, 2021: 9180-9192.